La startup cinese di intelligenza artificiale (IA) DeepSeek ha recentemente scosso il mercato lanciando un modello di IA innovativo e economico denominato R1. DeepSeek-R1 compete con modelli più costosi come ChatGPT di OpenAI. Inoltre, dimostra che lo sviluppo di un’IA avanzata non richiede necessariamente un investimento massiccio.

Chiaramente, il modello di IA efficiente di DeepSeek ha il potenziale di ampliare l’adozione dell’IA. Tuttavia, ha anche suscitato preoccupazione in merito all’utilizzo che il governo cinese farà dei dati raccolti. Le aziende hanno ragione a temere che i loro utenti possano esporre i dati sensibili dei clienti, i loro algoritmi proprietari o le loro strategie interne.

L’esposizione di dati a carattere personale può portare a violazioni al GDPR che possono avere conseguenze finanziarie importanti. Le ammende imposte dal GDPR possono ammontare fino a 20 milioni di euro o il 4% del fatturato annuale complessivo di un’azienda, ovvero il più alto tra i due. Inoltre, le infrazioni possono danneggiare la reputazione e intaccare la fiducia dei clienti.

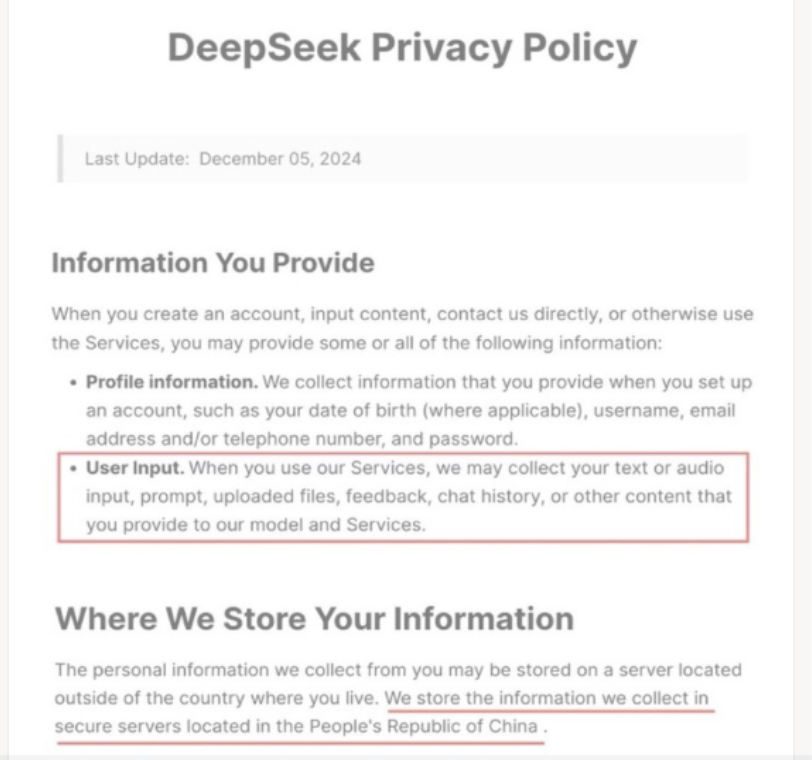

L’informativa sulla privacy di DeepSeek non aiuta a ridurre questi timori. È sufficiente leggere quanto sotto:

Informativa sulla privacy di DeepSeek

Per ridurre questi rischi, le aziende devono adottare un approccio completo che riunisce persone, processi e tecnologia. Devono implementare tecnologie che forniscono controlli sull’accesso e dati incentrati sulle persone, nonché definire solide policy interne e istituire comitati di governance dell’IA per la supervisione e l’orientamento. Devono anche essere in grado di monitorare l’utilizzo dell’IA e l’accesso ai dati. Infine, devono mettere in atto misure adeguate, come la formazione dei collaboratori e un solido framework etico.

Sicurezza incentrata sulle persone per l’IA generativa

L’adozione in sicurezza degli strumenti di IA generativa è una priorità per la maggior parte dei CISO. Proofpoint dispone di una piattaforma di sicurezza dei dati adattiva e incentrata sulle persone che può esserti d’aiuto. Questa nostra soluzione ti offre la visibilità e il controllo sull’IA generativa nella tua azienda.

A differenza delle soluzioni DLP e di filtraggio web di vecchia generazione che bloccano del tutto l’utilizzo delle applicazioni di IA generativa, Proofpoint può autorizzare, regolamentare e limitare in modo selettivo il loro utilizzo in base al comportamento degli utenti e ai contenuti che inseriscono.

Con Proofpoint Enterprise DLP, Proofpoint Data Security Posture Management e Proofpoint ZenGuide, ti aiutiamo ad applicare policy di utilizzo accettabile per gli strumenti di IA generativa pubblici nonché per i copilot aziendali e i modelli linguistici di grandi dimensioni (LLM) personalizzati.

Di seguito un elenco completo di cosa puoi ottenere con Proofpoint:

Visibilità sugli strumenti di IA generativa non approvati:

- Traccia l’utilizzo di oltre 600 siti di IA generativa per utente, gruppo o dipartimento interno.

- Monitora l’utilizzo di applicazioni di IA generativa grazie al contesto sui rischi legati agli utenti.

- Identifica le autorizzazioni delle applicazioni di IA di terze parti e genera avvisi in caso di accesso ai dati cloud, alle email, alle agende, ecc. dell’utente.

Applicazione di policy di utilizzo accettabile per gli strumenti di IA generativa:

- Blocca gli upload su web e l’inserimento di dati sensibili nei siti di IA generativa.

- Impedisci l’inserimento di informazioni sensibili in strumenti come DeepSeek, ChatGPT, Gemini, Claude e Copilot o oscura i dati sensibili inseriti nei prompt dell’IA utilizzando la nostra estensione del browser.

- Revoca o blocca le autorizzazioni delle applicazioni di IA generativa di terze parti.

- Monitora l’utilizzo di Copilot per Microsoft 365 e ricevi degli avvisi in caso di accesso a file sensibili tramite email, file e messaggi Teams.

- Rileva, etichetta e proteggi i file che contengono dati sensibili, inclusi i contenuti generati dall’IA.

Monitora le minacce interne grazie a policy di IA generativa dinamiche:

- Acquisisci metadati e schermate prima e dopo l’accesso degli utenti agli strumenti di IA generativa.

Prevenzione dell’esposizione di dati nei copilot e nei modelli LLM personalizzati:

- Classifica i dati e gestisci l’accesso ai dati da parte delle applicazioni di IA come Copilot per Microsoft 365 per assicurare che i contenuti generati dall’IA non espongano dati sensibili.

- Impedisci l’addestramento dei modelli di IA di base o personalizzati, compresi quelli di DeepSeek in AWS Bedrock e Azure OpenAI, su dati sensibili.

- Effettua un’analisi di sensibilità in tempo quasi reale dell’utilizzo dei dati da parte di piattaforme di IA generativa.

Formazione dei collaboratori sull’utilizzo accettabile degli strumenti di IA generativa:

- Sensibilizza gli utenti all’utilizzo sicuro dell’IA generativa con video, poster, moduli interattivi e newsletter.

- Automatizza la formazione personalizzata per i tuoi utenti più a rischio.

Una sicurezza dei dati che tiene il passo con i nuovi strumenti di IA generativa

Proofpoint è impegnata a monitorare costantemente il mercato dell’IA generativa e tenere il passo con i nuovi strumenti di IA. Il nostro approccio architetturale ci permette di innovare e implementare rapidamente nuove funzionalità con un impatto minimo sulla produttività degli utenti. Per esempio, una delle nostre soluzioni DLP è un’estensione del browser che previene la perdita di dati attraverso i prompt dell’IA generativa. Ciò ci ha permesso di adattarci rapidamente a DeepSeek.

DeepSeek-R1 è stato rilasciato il 20 gennaio. Il 30 gennaio, Proofpoint aveva già la capacità di applicare policy di utilizzo accettabile per DeepSeek e prevenire la perdita di dati. Una volta implementata l’estensione del browser Proofpoint per la DLP, non devi apportare alcuna modifica alla configurazione né effettuare aggiornamenti software. Implementiamo gli aggiornamenti dell’estensione del browser tramite il nostro sistema di backend. I nuovi siti come DeepSeek possono così essere supportati in modo trasparente.

Per saperne di più

Per confrontare le funzionalità di DeepSeek con quelle di altri modelli di IA, guarda il nostro webinar “DeepSeek and Beyond: Fortifying Data Security in the Era of GenAI” che si terrà martedì 11 febbraio 2025.

Per vedere una dimostrazione delle nostre soluzioni di sicurezza dei dati per l’IA generativa, guarda il nostro webinar “Defend Data: Innovations” che si terrà martedì 18 febbraio 2025.

Contatta il tuo account manager per scoprire come Proofpoint può aiutarti a implementare policy d’uso accettabile per gli strumenti di IA generativa e testare la nostra soluzione.