La startup chinoise d’intelligence artificielle (IA) DeepSeek a récemment secoué les marchés en lançant un modèle d’IA innovant et économique baptisé R1. Ce dernier rivalise avec des modèles plus coûteux tels que ChatGPT d’OpenAI. Qui plus est, il prouve que le développement d’une IA avancée ne nécessite pas forcément un investissement important.

De toute évidence, le modèle d’IA efficace de DeepSeek a le potentiel d’accroître l’adoption de l’IA. Il suscite toutefois des inquiétudes quant à l’utilisation que le gouvernement chinois fera des données collectées. Les entreprises ont raison de craindre que leurs utilisateurs exposent des données client sensibles, leurs algorithmes propriétaires ou leurs stratégies internes.

L’exposition de données personnelles peut entraîner des infractions au RGPD susceptibles d’avoir un impact financier considérable. Les amendes imposées par le RGPD peuvent atteindre 20 millions d’euros ou 4 % du chiffre d’affaires mondial annuel d’une entreprise, la valeur la plus élevée prévalant. En outre, les infractions peuvent porter atteinte à la réputation et éroder la confiance des clients.

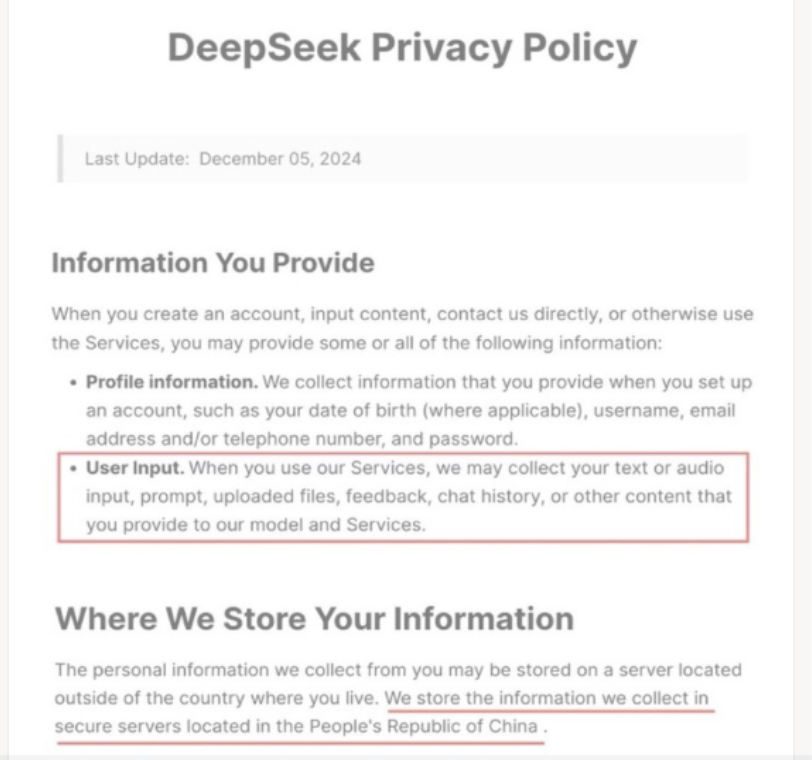

La déclaration de confidentialité de DeepSeek ne contribue en rien à apaiser ces inquiétudes. Il suffit de lire le passage ci-dessous :

Déclaration de confidentialité de DeepSeek

Pour réduire ces risques, les entreprises doivent adopter une approche complète qui allie personnes, processus et technologies. Elles doivent mettre en œuvre des technologies offrant des contrôles d’accès et de données centrés sur les personnes, ainsi qu’établir des règles internes robustes et mettre en place des comités de gouvernance de l’IA à des fins de supervision et d’orientation. Elles doivent être en mesure de surveiller l’utilisation de l’IA et l’accès aux données. Enfin, elles doivent mettre en place des mesures adaptées, comme la formation de leurs collaborateurs, ainsi qu’un cadre éthique solide.

Sécurité centrée sur les personnes pour l’IA générative

L’adoption sécurisée de l’IA générative est une priorité pour la plupart des RSSI. Proofpoint dispose d’une plate-forme de sécurité des données adaptative et centrée sur les personnes qui peut vous aider à cet égard. Cette solution vous offre à la fois visibilité et contrôle sur l’utilisation de l’IA générative dans votre entreprise.

Contrairement aux solutions DLP d’ancienne génération et au filtrage Web qui empêchent toute utilisation d’applications d’IA générative, Proofpoint peut autoriser, encadrer et restreindre leur utilisation de manière sélective en fonction du comportement des collaborateurs et du contenu qu’ils chargent.

Avec Proofpoint Enterprise DLP, Proofpoint Data Security Posture Management et Proofpoint ZenGuide, nous pouvons vous aider à appliquer des règles d’utilisation acceptable pour les outils d’IA générative publics ainsi que les copilotes d’entreprise et les grands modèles de langage (LLM) personnalisés.

Voici une liste complète de ce que vous pouvez accomplir avec Proofpoint :

Visibilité sur les outils d’IA générative non approuvés :

- Surveillez l’utilisation de plus de 600 sites d’IA générative par utilisateur, groupe ou département interne.

- Surveillez l’utilisation des applications d’IA générative avec un contexte reposant sur le risque utilisateur.

- Identifiez les autorisations des applications d’IA tierces et générez des alertes en cas d’accès aux données cloud, à la messagerie, au calendrier, etc. de l’utilisateur.

Application de règles d’utilisation acceptable pour les outils d’IA générative :

- Bloquez les chargements Web et le collage de données sensibles sur les sites d’IA générative.

- Prévenez la saisie de données sensibles dans des outils tels que DeepSeek, ChatGPT, Gemini, Claude et Copilot, ou masquez les données sensibles saisies dans des invites d’IA à l’aide de notre extension de navigateur.

- Révoquez ou bloquez les autorisations des applications d’IA générative tierces.

- Surveillez l’utilisation de Copilot pour Microsoft 365 et recevez des alertes en cas d’accès à des fichiers sensibles via la messagerie, des fichiers et des messages Teams.

- Détectez, étiquetez et protégez les fichiers contenant des données sensibles, y compris le contenu généré par l’IA.

Surveillance et identification des menaces internes au moyen de règles d’IA générative dynamiques :

- Capturez des métadonnées et enregistrez des captures d’écran avant et après que les utilisateurs accèdent à des outils d’IA générative.

Prévention de l’exposition de données dans des copilotes et de grands modèles de langage (LLM) :

- Classez les données et gérez l’accès aux données par des applications d’IA telles que Copilot pour Microsoft 365 pour vous assurer que le contenu généré par l’IA n’expose pas de données sensibles.

- Empêchez l’entraînement de modèles d’IA de base ou personnalisés, y compris ceux de DeepSeek dans AWS Bedrock et Azure OpenAI, sur des données sensibles.

- Procédez à une analyse de sensibilité en temps quasi réel de l’utilisation des données par des plates-formes d’IA générative.

Formation des collaborateurs à l’utilisation acceptable des outils d’IA générative :

- Sensibilisez les utilisateurs à l’emploi en toute sécurité de l’IA générative à l’aide de vidéos, d’affiches, de modules interactifs et de newsletters.

- Automatisez la mise à disposition de formations personnalisées pour les utilisateurs les plus à risque.

Une sécurité des données qui évolue au rythme des nouveaux outils d’IA générative

Proofpoint s’engage à surveiller en permanence le marché de l’IA générative et à suivre la cadence des nouveaux outils d’IA. Notre approche architecturale nous permet d’innover et de déployer rapidement de nouvelles fonctionnalités avec peu d’impact sur la productivité des utilisateurs. Par exemple, l’une de nos solutions DLP est une extension de navigateur qui prévient les fuites de données via des invites d’IA générative. Nous avons ainsi pu nous adapter rapidement à DeepSeek.

DeepSeek-R1 a été lancé le 20 janvier. Le 30 janvier, Proofpoint était déjà en mesure d’appliquer des règles d’utilisation acceptable pour DeepSeek et de prévenir les fuites de données. Une fois que vous avez implémenté l’extension de navigateur Proofpoint pour la DLP, aucun changement de configuration ni aucune mise à jour logicielle ne sont nécessaires. Nous déployons les mises à jour de l’extension de navigateur via notre système backend. Les nouveaux sites tels que DeepSeek peuvent donc être pris en charge de façon transparente.

En savoir plus

Pour comparer les fonctionnalités de DeepSeek à celles d’autres modèles d’IA, participez à notre webinaire « DeepSeek and Beyond: Fortifying Data Security in the Era of GenAI » le mardi 11 février 2025.

Pour voir une démonstration de nos solutions de sécurité des données pour l’IA générative, participez à notre webinaire « Defend Data: Innovations » le mardi 18 février 2025.

Contactez votre responsable de compte pour découvrir comment Proofpoint peut vous aider à mettre en œuvre des règles d’utilisation acceptable pour les outils d’IA générative et tester notre solution.