AIは現在、業務の進め方そのものに組み込まれています。Copilotは従業員をリアルタイムで支援します。自律型エージェントはデータの取得、コンテンツ生成、コード作成、ワークフローの実行を行い、企業システム全体にわたって機能します。AIの機能は、コラボレーションプラットフォーム、開発者ツール、そして中核となる業務アプリケーションに直接統合されています。

これがエージェント型ワークスペースです。人とAIエージェントが共に稼働し、同じデータにアクセスし、同一のシステム上で動作する環境です。CIOやCISOにとって、これは新たなセキュリティおよびガバナンス上の課題をもたらします。

AI主導のガバナンスギャップ

Acuvityの2025年AIセキュリティレポート(Acuvityは、現在はプルーフポイントの一事業体です)によると、約70%の組織がAIガバナンスにギャップがあると報告しており、さらに約50%が12か月以内にAI関連のデータ損失が発生する可能性があるとしています。AIエージェントが企業のワークフローに組み込まれるにつれ、このギャップはもはや理論上の問題ではなく、実務上の課題となっています。

課題は、多くのセキュリティアーキテクチャがこのモデルを前提として設計されていない点にあります。従来は「このユーザーにアクセス権はあるか」「このデバイスは信頼できるか」「この通信は許可されているか」といった基本的な問いに答えるために構築されてきました。

自律型AIは、リスクの前提を根本からくつがえします。単一のAIリクエストが、メール、クラウドストレージ、CRMシステム、コードリポジトリなどにまたがる数十の後続処理を引き起こす可能性があり、その多くは機械の速度で、人間の関与が限られた状態で実行されます。エージェントは許可された権限内で動作していても、元のリクエストの目的と整合しない行動を取る可能性があります。

これはセマンティックな権限昇格です。技術的には許可されているものの、文脈的には不適切なアクションを指します。既存のツールは認証情報の検証やトラフィックの監視は可能ですが、AIの挙動が意図に沿っているかどうかを継続的に判断することは困難です。

アクセス制御から意図検証へ

人間は企業システムを利用する際に、誠実に行動することが求められます。また、自らの行動を業務目的と整合させる責任を負います。AIエージェントも同様の基準で管理される必要があります。

しかし、AIシステムは本質的に意図を理解しているわけではありません。与えられた権限の範囲で動作し、目的に向かって最適化を行います。何が許可されているかと、何が適切であるかを区別することはできません。

意図ベースのセキュリティは、この課題に対処するために、AIの挙動が自律的に開始されたものであれ、ユーザーによるものであれ、元のリクエストや企業ポリシーと整合しているかを継続的に評価します。これは根本的な転換を意味します。

- アクセスの検証から整合性の検証へ

- 静的なポリシー適用から実行時の検査へ

- 事後的な調査から継続的な検証へ

Agent Integrity Frameworkの導入

この変革を実運用に落とし込むために、プルーフポイントはAgent Integrity Frameworkを導入します。

Agent Integrityとは、AIエージェントがあらゆるインタラクション、ツール呼び出し、データアクセスにおいて、意図された目的、認可された権限、期待される振る舞いの範囲内で動作している状態を指します。

このフレームワークは、Intent Alignment(意図の整合性)、Identity and Attribution(アイデンティティとアトリビューション)、Behavioral Consistency(行動の一貫性)、Auditability(監査可能性)、Operational Transparency(運用の透明性)の5つの柱で構成されています。また、発見から実行時の強制適用に至るまで、組織を導く5段階の成熟度モデルも含まれています。

これにより、CIOやCISOはエージェント型ワークスペースという新たなコントロールプレーンを管理するための指針を得ることができます。

- 目標はエージェントへの信頼の確立です。

- Integrity Frameworkが統治の枠組みを提供します。

- 意図ベースのセキュリティが実行基盤として機能します。

人・データ・AIのための統合プラットフォーム

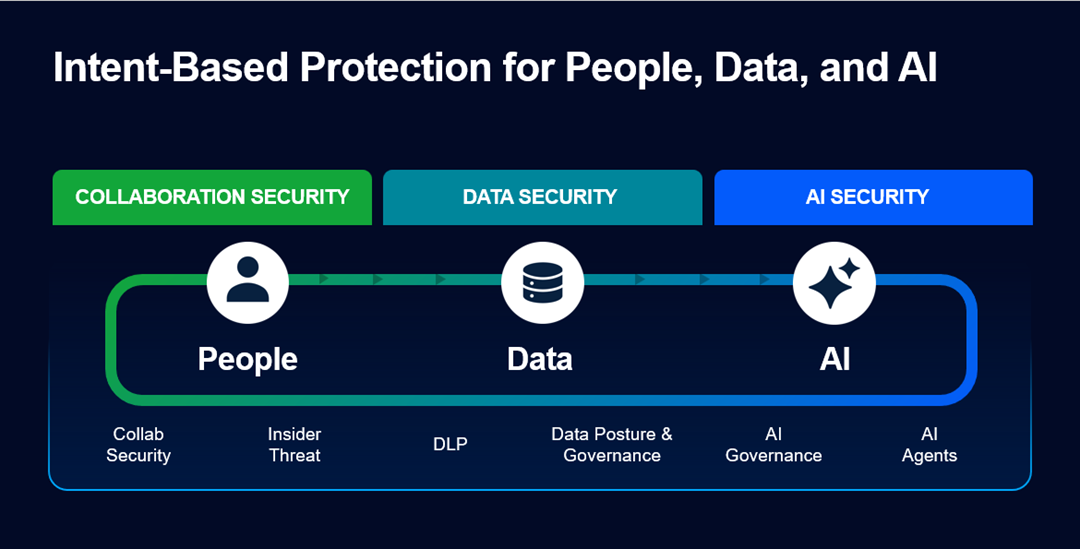

これらの機能を実現するために、本日、プルーフポイントはProofpoint AI Securityを発表しました。これは、人およびAIエージェントとシステム、データ、AIツールとのインタラクションを企業全体で保護するよう設計された、業界をリードする統合型の意図ベースAIセキュリティソリューションです。

本ソリューションは、プルーフポイントの人を中心としたセキュリティの基盤の上に成り立っています。当社のプラットフォームは、「セキュリティは人から始まるべきである」というシンプルな前提から出発しました。私たちは、静的なルールを超え、人のレイヤーにおける意図や行動に基づく検知モデルへと進化し、コミュニケーションやユーザーが機密データとどのように関わるかを分析してきました。この経験が、コラボレーションセキュリティ、内部リスク管理、データ損失防止における高い実効性を支えています。

AIが企業のワークフローに組み込まれるにつれて、私たちはこのモデルをデータにも拡張しました。今年初めには、AI主導の環境において機密情報を保護するAIデータガバナンスの提供を開始しました。エージェント型技術を活用し、大規模なデータの発見、分類、アクセスガバナンスに対応し、機密データを動的に特定するとともに、適切な人と適切なAIエージェントのみがアクセスできるようにします。ポリシーに依存した硬直的なアプローチとは異なり、データの移動や変化に応じて柔軟に適応します。

最後のステップは、AIの振る舞いそのものを管理することでした。AIシステムは単に情報へアクセスするだけでなく、接続されたシステム全体にわたって推論し、行動します。今回のProofpoint AI Securityの提供開始により、エンドポイント、ブラウザ、MCP接続にわたるAIネイティブな可視化と意図ベースの実行時保護を追加し、人、データ、AIのすべてにわたる保護を完成させました。

Agent Integrity(エージェントの整合性)は新たなコントロールプレーン

AIの導入が加速する中で、組織はスピードとセキュリティのどちらかを選ぶ必要はありません。

もはや本質的な問いは、エージェントにアクセス権があるかどうかではありません。重要なのは、その振る舞いが意図と一致しているかを、機械の速度で、かつ関与するすべてのシステムにわたって継続的に検証できるかどうかです。

だからこそ、意図ベースのセキュリティとAIエージェントのIntegrityが重要になります。意図ベースのセキュリティは継続的な検証を担い、AIエージェントのIntegrityは行動の基準を定義します。この2つが組み合わさることで、自律型AIの時代における企業の基盤となる重要な能力が実現されます。